L’équipe du MIT propose PhotoGuard pour contrecarrer les modèles d’IA deepfake

Les informaticiens affirment avoir trouvé un moyen de contrecarrer les tentatives des systèmes d’apprentissage automatique de manipuler numériquement les images et de créer des deepfakes.

De nos jours, vous pouvez non seulement créer des images à partir de zéro à l’aide de modèles d’IA – il suffit de leur donner une description écrite et elles produiront les photos correspondantes – vous pouvez également manipuler des images existantes en utilisant la même technologie. Vous pouvez donner une image à ces systèmes formés et décrire comment vous voulez qu’elle soit modifiée, ou utiliser une interface graphique pour les diriger, et c’est parti.

Cela crée le potentiel d’un avenir terrifiant dans lequel les médias sociaux sont inondés de désinformation de masse automatisée, ou les gens sont soumis à un chantage sur des clichés tordus par des machines. Si personne ne peut distinguer les faux des vrais, ils peuvent être tout aussi dommageables.

Une approche pour éviter cela consiste à filigraner ou à signer numériquement les images et autres contenus afin que les manipulations soient détectables. Une autre voie – proposée par les cerveaux du MIT – consiste à concevoir des clichés afin que les modèles d’IA ne puissent pas du tout les modifier en premier lieu.

“Envisagez la possibilité d’une propagation frauduleuse de faux événements catastrophiques, comme une explosion à un point de repère important”, a déclaré Hadi Salman, un étudiant diplômé du département de génie électrique et d’informatique de l’université qui a travaillé sur ce projet.

“Cette tromperie peut manipuler les tendances du marché et l’opinion publique, mais les risques ne se limitent pas à la sphère publique. Les images personnelles peuvent être modifiées de manière inappropriée et utilisées à des fins de chantage, ce qui entraîne des implications financières importantes lorsqu’elles sont exécutées à grande échelle.”

Salman a peut-être raison. Les deepfakes ont déjà été utilisés pour diffuser des informations erronées ou tromper et harceler les internautes, et les images conçues par l’IA sont devenues de plus en plus réalistes. À mesure que la technologie s’améliorera à l’avenir, les gens pourront également créer des vidéos avec un faux son réaliste, a-t-il averti.

C’est pourquoi Salman et ses collègues ont décidé de développer un logiciel d’apprentissage automatique, baptisé PhotoGuard, pour empêcher les malfaiteurs d’utiliser ces outils à mauvais escient pour manipuler le contenu.

Les images sont essentiellement traitées par les modèles ML comme des tableaux de nombres. PhotoGuard ajuste ces tableaux afin d’empêcher d’autres modèles d’apprentissage automatique de percevoir correctement l’image d’entrée – de sorte que l’image ne puisse finalement pas être manipulée. Les pixels sont laissés intacts en ce qui concerne les personnes, de sorte que l’image protégée est la même pour l’œil humain, mais pas pour un ordinateur.

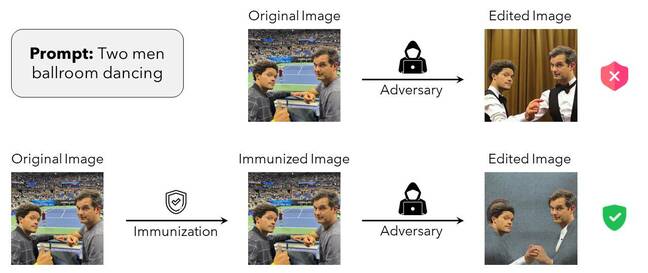

Dans l’exemple ci-dessous, une photo montre les humoristes de la télévision américaine Trevor Noah et Michael Kosta à l’US Open. La photo originale – non protégée – peut être manipulée par un modèle de diffusion basé sur le texte pour les faire apparaître dans un cadre complètement différent : dans une salle de bal dansant ensemble. Cependant, avec les modifications PhotoGuard appliquées, le modèle de diffusion est ébranlé par les perturbations invisibles et ne peut pas complètement modifier l’image.

Figure de l’article MIT PhotoGuard décrivant le fonctionnement de cette immunisation des données contre la manipulation – Cliquez pour agrandir

“Dans cette attaque, nous perturbons l’image d’entrée afin que l’image finale générée par le [large diffusion model] est une image cible spécifique (par exemple, un bruit aléatoire ou une image grise) », ont écrit les universitaires dans leur article non évalué par des pairs décrivant PhotoGuard, publié sur ArXiv.

À proprement parler, cette approche est qualifiée d’attaque par diffusion par l’équipe du MIT. Son objectif est d’embrouiller l’IA de manipulation d’images et de lui faire ignorer efficacement l’invite de texte qui lui a été donnée.

Il existe une deuxième technique plus simple appelée attaque d’encodeur, qui tente de faire en sorte que l’IA manipulatrice perçoive une photo comme autre chose – comme un carré gris – qui contrecarre son édition automatisée. Le résultat est plus ou moins le même, dans les deux sens : les tentatives d’utilisation de l’IA pour manipuler les images déraillent.

“Lors de l’application de l’attaque de l’encodeur, notre objectif est de mapper la représentation de l’image d’origine sur la représentation d’une image cible (image grise)”, écrit l’équipe dans son article. “Notre attaque par diffusion (plus complexe), en revanche, vise à briser le processus de diffusion en manipulant l’ensemble du processus pour générer une image qui ressemble à une image cible donnée (image grise).”

Ils ont mené leurs expériences contre le modèle de diffusion stable v1.5 de Stability AI et ont noté que bien que PhotoGuard puisse protéger les images contre la modification numérique par l’IA, il est difficile à appliquer en pratique. D’une part, l’attaque par diffusion nécessite une capacité GPU considérable – donc si vous n’avez pas ce type de silicium à portée de main, vous n’avez pas de chance.

Vraiment, la responsabilité devrait incomber aux organisations développant ces outils d’IA plutôt qu’aux individus essayant de protéger leurs images, affirment les chercheurs.

“Une approche collaborative impliquant des développeurs de modèles, des plateformes de médias sociaux et des décideurs présente une défense solide contre la manipulation d’images non autorisée. Travailler sur cette question urgente est d’une importance primordiale aujourd’hui”, a expliqué Salman.

“Et bien que je sois heureux de contribuer à cette solution, beaucoup de travail est nécessaire pour rendre cette protection pratique. Les entreprises qui développent ces modèles doivent investir dans l’ingénierie d’immunisations robustes contre les menaces possibles posées par ces outils d’IA. Alors que nous entrons dans ce nouveau l’ère des modèles génératifs, luttons pour le potentiel et la protection à parts égales.”

PhotoGuard n’est pas une solution parfaite. Si une image peut être téléchargée par n’importe qui sans qu’aucune protection ne lui soit appliquée, un malfaiteur pourrait saisir cette version non protégée de la photo, la modifier à l’aide de l’IA et la distribuer. De plus, le recadrage, la rotation ou l’application de certains filtres pourraient interrompre les perturbations de PhotoGuard.

Les bods du MIT ont déclaré qu’ils travaillaient pour essayer de rendre leur logiciel open source (licence MIT, natch) plus robuste contre de telles modifications.

Le registre a demandé à Salman de commenter davantage. ®